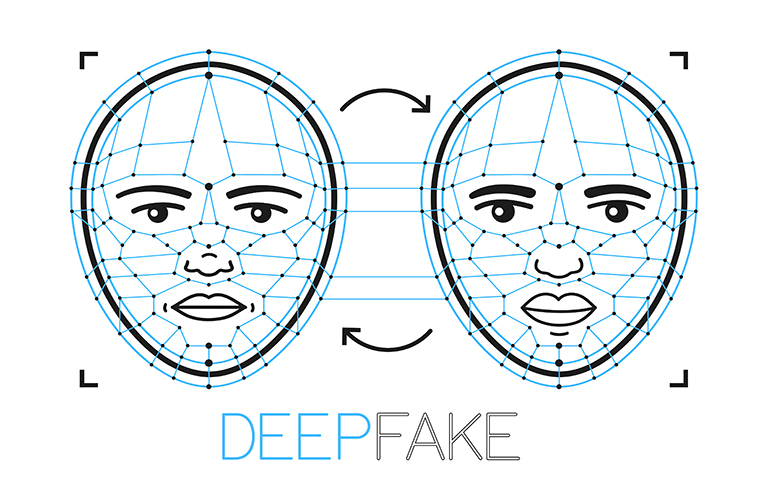

Technologia deepfake to dziś jedno z najbardziej wpływowych narzędzi sztucznej inteligencji i jedno z tych, które może zmienić sposób, w jaki postrzegamy informacje w świecie cyfrowym. Deepfake to media syntetyczne, czyli obrazy, filmy lub nagrania głosowe tworzone przez algorytmy sztucznej inteligencji, które naśladują lub generują treści wyglądające jak prawdziwe, ale w rzeczywistości nie mają związku z rzeczywistymi wydarzeniami lub osobami.

W praktyce oznacza to, że za pomocą nowoczesnych narzędzi komputerowych można wygenerować film z twarzą znanej osoby, która nie mówi tego, co widać na ekranie, albo podłożyć komuś dźwięk tak, jak nigdy wcześniej nie brzmiał. W pierwszych latach technologii takie manipulacje wyglądały często nieco sztucznie, ale obecnie algorytmy AI są tak zaawansowane, że przeciętny odbiorca może nie dostrzec, iż ogląda lub słucha czegoś, co zaprojektowano w komputerze, a nie nagrano naprawdę.

Deepfake powstają dzięki technikom uczenia maszynowego, które analizują ogromne ilości danych - zdjęć, nagrań wideo i audio, aby nauczyć się charakterystycznych cech wyglądu i głosu konkretnej osoby. Następnie te dane są wykorzystywane do generowania nowych materiałów, które wyglądają na autentyczne. Dzięki temu możemy zobaczyć kogoś, kto nigdy nie wypowiedział danej frazy lub usłyszeć głos osoby w sytuacji, która nigdy nie miała miejsca.

To właśnie wiarygodność i realność takich materiałów budzą największe obawy ekspertów i organizacji monitorujących dezinformację. Postęp w tej technologii sprawia, że deepfake są coraz bardziej realistyczne. Badacze informują o filmach z wyraźną imitacją detali, takich jak czerwienienie twarzy czy puls serca, które jeszcze kilka lat temu były nie do odtworzenia.

Najbardziej niebezpieczne w deepfake’ach jest to, że mogą one łatwo zwieść ludzi, zwłaszcza w kontekście informacji politycznych, finansowych czy społecznych. W erze mediów społecznościowych treści rozchodzą się błyskawicznie i bez szczególnej weryfikacji, co stwarza idealne warunki do rozpowszechniania fałszywych komunikatów. Każdy z nas może zobaczyć fake bez świadomości, że ma do czynienia z manipulacją.

Przykłady wykorzystania tej technologii są coraz częstsze i nie zawsze dotyczą fikcji. W ostatnich miesiącach Bank Włoch ostrzegał, że fałszywe filmy i artykuły wykorzystujące deepfake z wizerunkiem gubernatora banku rozprzestrzeniały się w Internecie i miały służyć oszustwom finansowym. W Australii nagłośniono przypadki tworzenia treści seksualnych bez zgody osób przedstawionych w deepfake’ach oraz wezwania do odpowiedzialności twórców takich materiałów i ich platform publikacji. Również niezależni badacze i dziennikarze wskazują, że podczas konfliktów zbrojnych manipulowane obrazy i filmy mogą być szeroko rozpowszechniane, aby wprowadzić opinię publiczną w błąd co do faktycznych wydarzeń na froncie.

Przykładów deepfake’ów jest coraz więcej, zarówno tych poważnych, jak i tych, które trafiają do memów lub rozrywki. Jednym z głośnych przypadków było stworzenie materiału wideo z prezydentem Ukrainy, który miał nakłaniać do poddania się, co szybko okazało się fałszywką rozpowszechnianą w czasie wojny. Są też deepfaki znanych osób w kontekście kampanii reklamowych, a nawet zmanipulowane nagrania głosowe przedstawicieli partii politycznych i celebrytów, które wywołały skandal lub przypięły etykietę kontrowersyjnych newsów.

Jednym z najbardziej niepokojących obszarów wykorzystania technologii deepfake jest pornografia i materiały o charakterze seksualnym tworzonym bez zgody osób przedstawionych. W ostatnich latach setki znanych twarzy trafiły na takie fałszywe filmy lub zdjęcia, co doprowadziło do ogromnej presji społecznej na prawodawstwo i platformy internetowe, aby wyeliminować publikowanie tego typu treści i chronić prywatność.

Dlaczego ta technologia jest tak niebezpieczna? Po pierwsze dlatego, że trudna jest do odróżnienia od prawdy. Nawet eksperci informatycy mają problemy z wykryciem najbardziej zaawansowanych deepfake’ów bez specjalnego oprogramowania i czasu na analizę. Po drugie fałszywe materiały mogą wpływać na decyzje ludzi: od głosowania w wyborach, przez inwestowanie pieniędzy, aż po decyzje osobiste oparte na emocjonalnym odbiorze materiałów wideo lub audio. Po trzecie naruszenie prywatności i reputacji. Deepfaki mogą zniszczyć dobre imię osoby publicznej lub prywatnej, oskarżając ją o rzeczy, których nigdy nie zrobiła.

Zagrożenia te skłaniają wiele instytucji, organizacji pozarządowych, firm technologicznych i rządów do opracowywania metod detekcji oraz prawnych ram przeciwdziałania. Jednym z kluczowych elementów walki z deepfake’ami jest edukacja użytkowników sieci i rozwijanie umiejętności krytycznego myślenia przy ocenie treści online. Ponieważ media społecznościowe są głównym kanałem rozpowszechniania informacji, warto zawsze sprawdzać źródła publikacji i unikać natychmiastowego wierzenia wszystkiemu, co widzimy lub słyszymy.

Kolejnym ważnym narzędziem są technologie i narzędzia wykrywania deepfake’ów. Badacze informatyki pracują nad algorytmami, które analizują niuanse obrazu lub dźwięku, aby wychwycić subtelne artefakty i nieregularności pozostawione przez proces ich tworzenia. Inne narzędzia sprawdzają metadane plików lub analizują kontekst publikacji danego materiału. Chociaż żaden system nie jest jeszcze doskonały, w połączeniu z wyczuleniem użytkownika na niestandardowe treści daje to realne szanse na ograniczenie rozpowszechniania fałszywych materiałów.

Każdy użytkownik Internetu może przyczynić się do ograniczenia szkód związanych z deepfake’ami. Oto kilka praktycznych zasad, które pomagają chronić się przed manipulacją:

Zachowuj ostrożność wobec materiałów wirusowych, szczególnie tych publikowanych przez nieznane lub nowych użytkowników.

Sprawdzaj źródła informacji i czy treść pochodzi z oficjalnej strony lub zaufanego konta, czy z przypadkowej strony czy profilu.

Korzystaj z narzędzi fact-checkingowych i rozsądnego podejścia do tego, co widzisz. Jeśli coś wygląda zbyt sensacyjnie, by było prawdziwe, istnieje duża szansa, że jest zmanipulowane.

Unikaj udostępniania treści, których nie jesteś absolutnie pewien, zwłaszcza jeśli dotyczy to nagrań z osobami publicznymi lub ważnymi wydarzeniami społecznymi.

Adrian Pluta

E-mail: Ten adres pocztowy jest chroniony przed spamowaniem. Aby go zobaczyć, konieczne jest włączenie w przeglądarce obsługi JavaScript.